AI Agent Harnesses Infrastructuur-Centrische AI Ontwikkeling

Waarom in 2026 niet het AI-model, maar de agent harness (infrastructuur, geheugen en tooling) bepaalt of je AI-agents echt betrouwbaar werken.

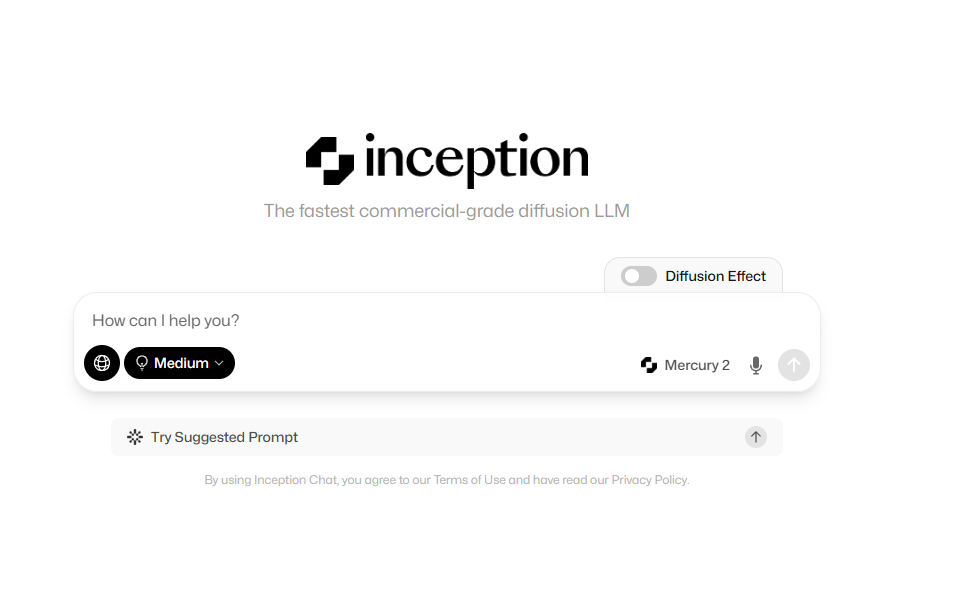

De afgelopen jaren draaide vrijwel elke AI-discussie om één vraag: welk model is het beste? GPT-4, Claude, Gemini — sneller, slimmer, groter context window. Maar terwijl iedereen naar de motor keek, bleek in de praktijk iets anders doorslaggevend.

Niet de motor bepaalt of je de race wint. De auto doet dat.

In 2026 verschuift de focus daarom van het model zelf naar de infrastructuur eromheen: de agent harness. Dat klinkt technisch, maar het idee is eigenlijk verrassend logisch. In dit artikel neem ik je stap voor stap mee — eerst begrijpelijk, daarna technisch — zodat je niet alleen weet wat het is, maar ook waarom het zo belangrijk wordt.

Model vs Harness — De Auto Analogie

Stel je een extreem krachtige motor voor. 800 pk. Perfect afgesteld. Maar je zet die motor op de grond zonder chassis, zonder stuur, zonder remmen en zonder dashboard.

Wat heb je dan? Een indrukwekkend stuk techniek… waar je niets mee kunt.

Dat is precies wat een AI-model is zonder goede infrastructuur. Het model kan redeneren, tekst genereren, plannen maken. Maar het kan niet zelfstandig:

- Bijhouden wat het gisteren deed

- Beslissen wat bewaard moet blijven

- Fouten systematisch herstellen

- Over meerdere sessies consistent blijven

- Veilig omgaan met tools en externe systemen

Daar komt de harness in beeld.

De harness is de complete auto: stuur, remmen, navigatie, brandstofregeling, onderhoudsboekje en veiligheidssystemen. Het model is de motor — krachtig, maar zonder besturing nutteloos.

De harness is de complete auto: stuur, remmen, navigatie, brandstofregeling, onderhoudsboekje en veiligheidssystemen. Het model is de motor — krachtig, maar zonder besturing nutteloos.

Wat Doet een Harness Concreet?

Een agent harness is in feite de besturingslaag die bepaalt hoe het model zich gedraagt in de echte wereld. Het bestaat meestal uit meerdere onderdelen:

- Contextbeheer

- Wat geef je het model wél en wat niet? Alles in de prompt stoppen lijkt handig, maar leidt vaak tot ruis en verwarring.

- Extern geheugen

- In plaats van alles in het context window te bewaren, gebruik je bestanden of een database als langetermijngeheugen.

- Tool orchestratie

- Welke tools mag de agent gebruiken? Hoe zien de interfaces eruit? Wat gebeurt er bij een mislukte call?

- Error recovery

- Wat als een test faalt? Wat als een API timeout geeft? Een goede harness vangt dat op en stuurt bij.

- Logging & observability

- Zonder logs heb je geen idee waarom een agent faalt. Een harness zorgt dat alles traceerbaar blijft.

Zie het als het verschil tussen een slimme stagiair zonder begeleiding, en dezelfde stagiair in een goed georganiseerd bedrijf met duidelijke processen.

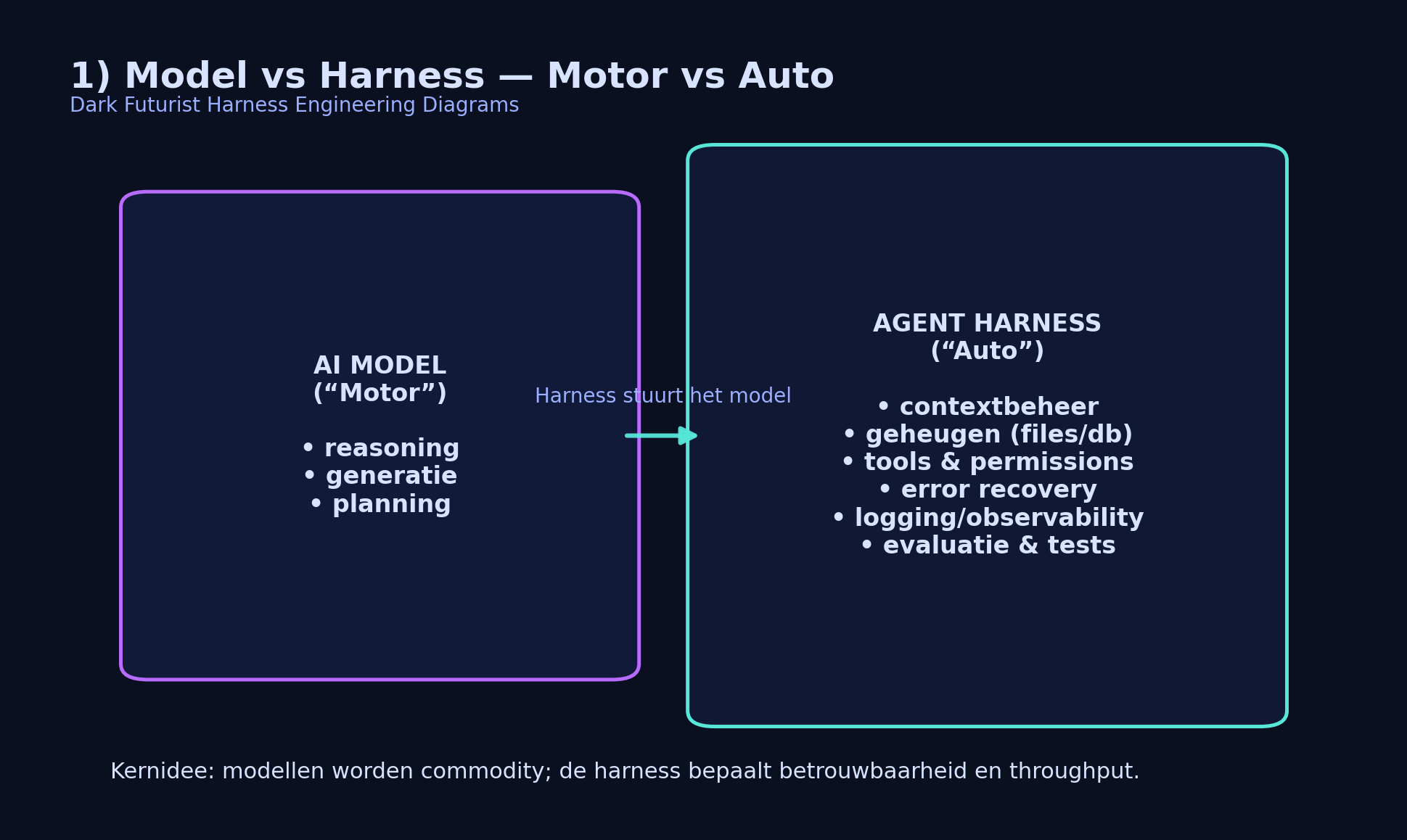

Minimalistische Architectuur (Best Practice)

Een interessante ontwikkeling is dat krachtigere modellen vaak beter functioneren in een simpelere omgeving.

Dat klinkt tegenstrijdig. Je zou denken: hoe meer tools, hoe beter. Maar in de praktijk zien veel teams het tegenovergestelde gebeuren.

Wanneer een agent toegang krijgt tot tientallen gespecialiseerde tools, moet het model eerst kiezen welke tool geschikt is, daarna correct parameters invullen, daarna omgaan met foutmeldingen. Elke stap is een extra kans op misinterpretatie.

Wanneer een agent toegang krijgt tot tientallen gespecialiseerde tools, moet het model eerst kiezen welke tool geschikt is, daarna correct parameters invullen, daarna omgaan met foutmeldingen. Elke stap is een extra kans op misinterpretatie.

Door de toolset te beperken tot eenvoudige, voorspelbare hulpmiddelen — bijvoorbeeld standaard bash-commando’s zoals ls, cat en grep — wordt het gedrag vaak consistenter.

Minder keuzestress. Minder ruis. Meer stabiliteit.

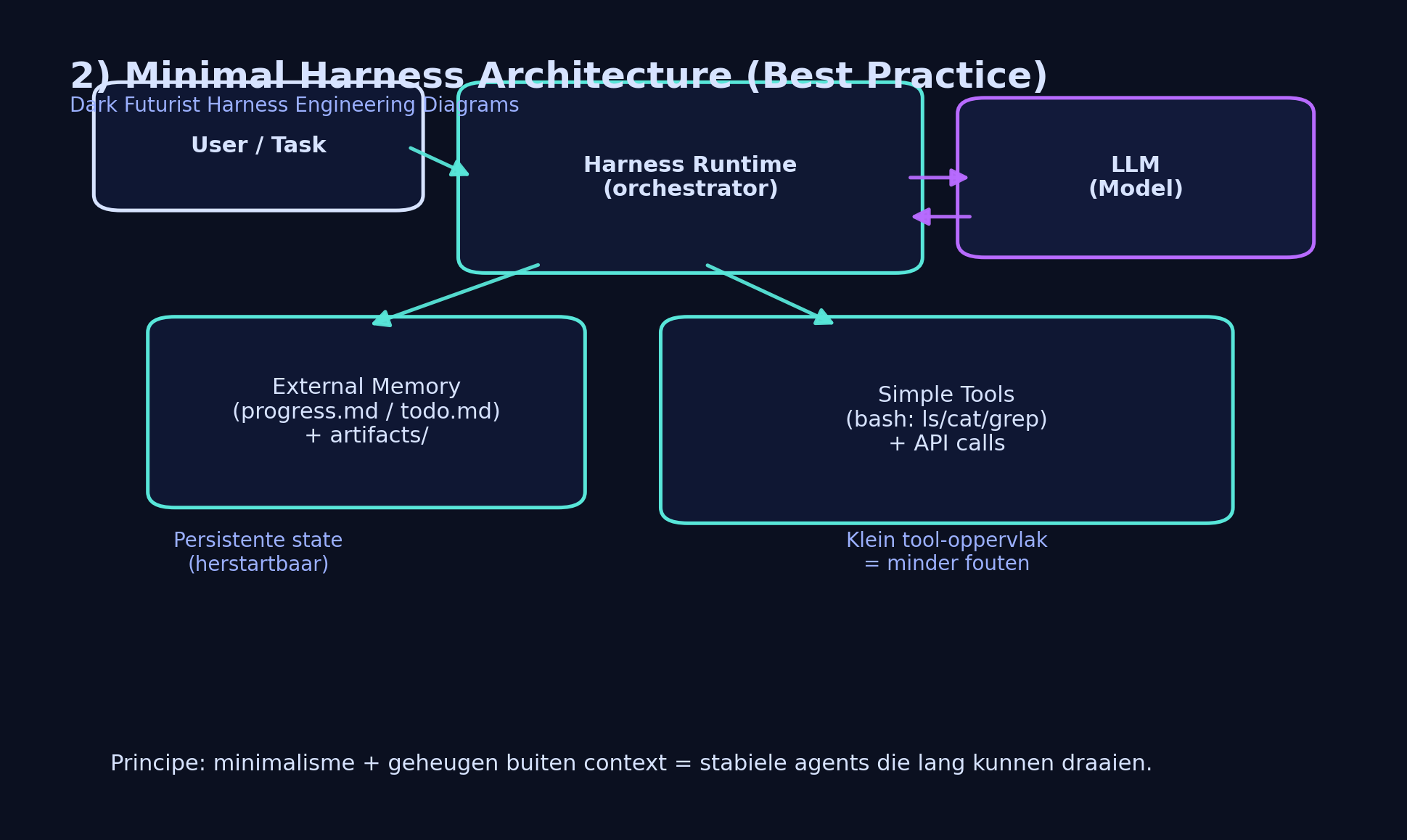

De Anti-Pattern: Te Veel Tools

Overengineering is verleidelijk. Je bouwt routers, speciale API wrappers, complexe schema’s, evaluatiemodules. Het voelt professioneel. Maar voor een taalmodel kan dit een doolhof worden.

Wat er dan gebeurt:

Wat er dan gebeurt:

- De agent kiest de verkeerde tool.

- De output wordt verkeerd geïnterpreteerd.

- De volgende stap bouwt voort op een fout.

- Fouten stapelen zich op.

Meer mogelijkheden betekenen niet automatisch betere prestaties. Soms is het tegenovergestelde waar.

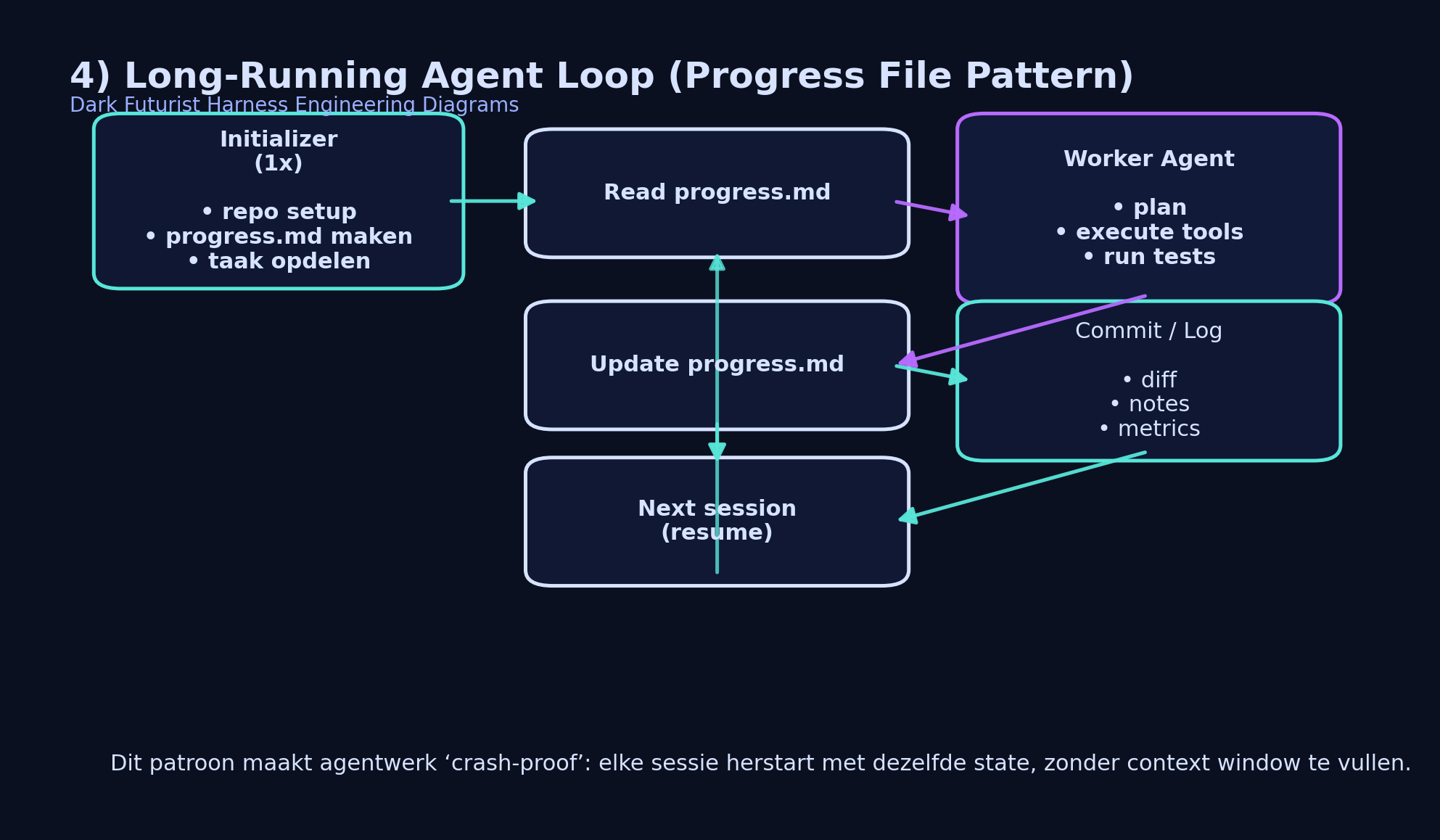

Long-Running Agents & Progress Files

Een van de grootste uitdagingen bij AI-agents is geheugen. Modellen hebben een beperkt context window. Als je alles daarin stopt, ontstaat er ruis. Bovendien “vergeet” het model wat buiten de huidige sessie valt.

Een elegante oplossing is het gebruik van een eenvoudig voortgangsbestand — bijvoorbeeld progress.md.

De werkwijze is simpel:

De werkwijze is simpel:

- De agent leest bij elke start het progress-bestand.

- Voert één concrete taak uit.

- Update het bestand met de nieuwe status.

Zo ontstaat langetermijngeheugen buiten het model zelf. De agent kan dagen of weken werken zonder alles in het context window te proppen.

Voorbeeld Progress File Implementatie

# Lees voortgang

with open("progress.md", "r") as f:

state = f.read()

response = call_model(task, state)

with open("progress.md", "w") as f:

f.write(response.updated_state)

Het is bijna schokkend hoe effectief deze simpele techniek kan zijn.

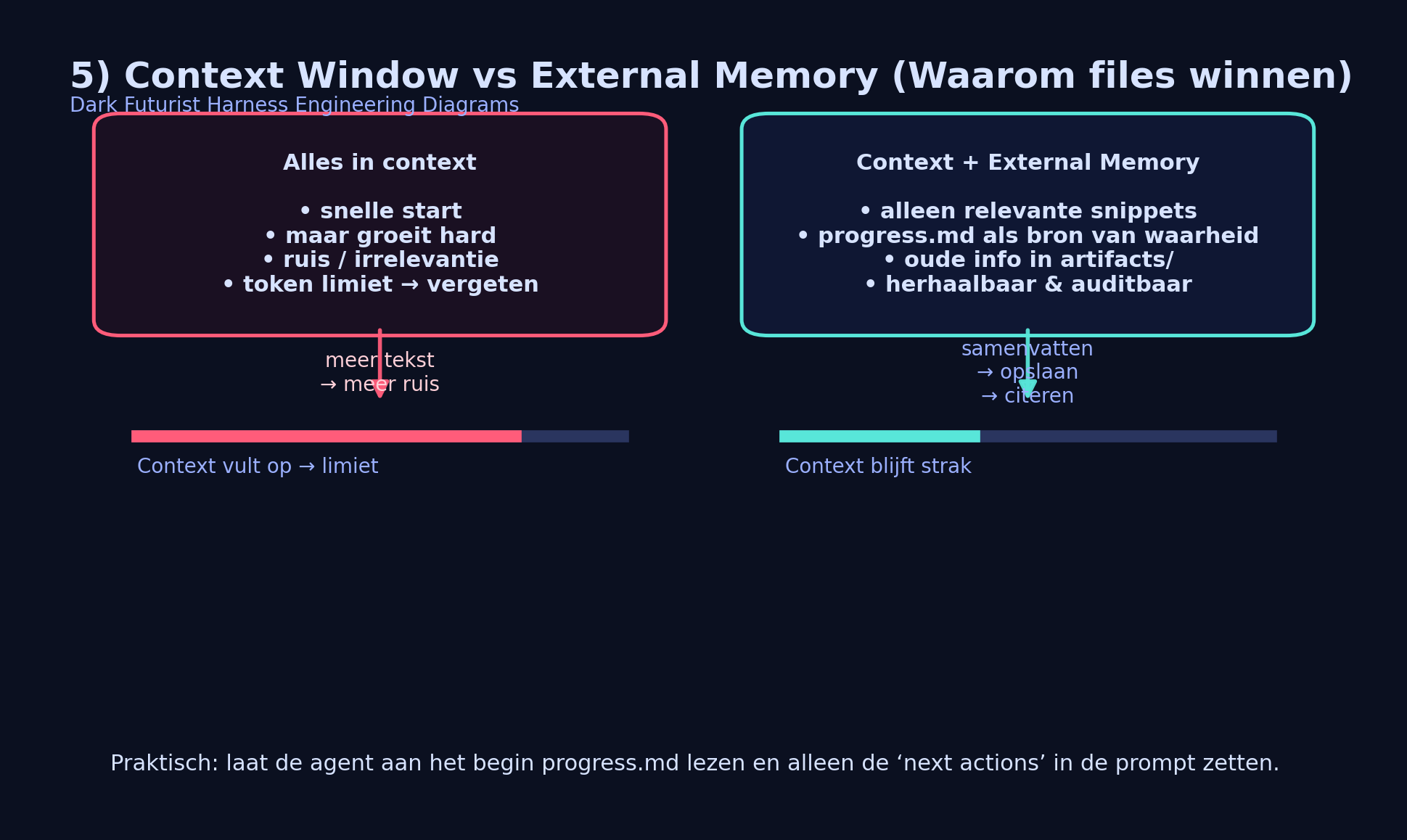

Context Window vs External Memory

Grote context windows zijn indrukwekkend, maar ze lossen niet alles op. Hoe meer tekst je toevoegt, hoe groter de kans op irrelevantie en verwarring.

Extern geheugen — in bestanden, een repo of een database — maakt het mogelijk om alleen de relevante stukken in de prompt te injecteren. De rest blijft veilig opgeslagen buiten het model.

Extern geheugen — in bestanden, een repo of een database — maakt het mogelijk om alleen de relevante stukken in de prompt te injecteren. De rest blijft veilig opgeslagen buiten het model.

Dat maakt agents stabieler, schaalbaarder en beter controleerbaar.

The Bitter Lesson (Richard Sutton)

Algemene, schaalbare methoden winnen uiteindelijk van menselijke slimme trucjes.

Richard Sutton schreef dit in zijn beroemde essay The Bitter Lesson. Zijn punt: systemen die kunnen schalen met rekenkracht en herhaling winnen op de lange termijn van handmatig ontworpen heuristieken.

Toegepast op agents betekent dit:

- Niet steeds ingewikkeldere prompts bouwen.

- Niet steeds meer regels toevoegen.

- Maar infrastructuur ontwerpen die herhaalbaar en schaalbaar is.

Een goede harness laat het model denken — maar dwingt het systeemmatig om consistent, controleerbaar en veilig te blijven.

Conclusie

In 2026 wint niet het model met de hoogste benchmarkscore. De winnaar is degene die de beste infrastructuur bouwt.

Harness engineering wordt daarmee een kernvaardigheid voor AI-ontwikkelaars. Niet omdat het model onbelangrijk wordt — maar omdat het model pas echt tot zijn recht komt binnen een goed ontworpen systeem.

De motor wordt steeds krachtiger.

Maar degene die de beste auto bouwt, wint de race.